三大LLM——なぜ比較が難しいのか

Claude 4.5、GPT-5、Gemini 2.5。 2026年4月時点で、この三つが大規模言語モデルの三強だ。 だが、「どれが最も優れているか」という問いに単純な答えはない。

それぞれのモデルは異なる設計思想で作られ、得意領域が異なる。 ベンチマークの数字だけで判断すると、実務での使い勝手と乖離することがある。 本記事では、実際のユースケースに基づいて三大LLMの実力を検証する。

基本スペック比較

| 項目 | Claude 4.5 | GPT-5 | Gemini 2.5 |

|---|---|---|---|

| 提供元 | Anthropic | OpenAI | Google DeepMind |

| コンテキスト長 | 200Kトークン | 128Kトークン | 1Mトークン |

| マルチモーダル | テキスト・画像・PDF | テキスト・画像・音声・動画 | テキスト・画像・音声・動画 |

| API価格(入力) | 中程度 | 高め | 低め |

| 特徴 | 安全性と正確性 | 汎用性と創造性 | 長文処理とGoogle連携 |

ユースケース別の強み

コーディング支援

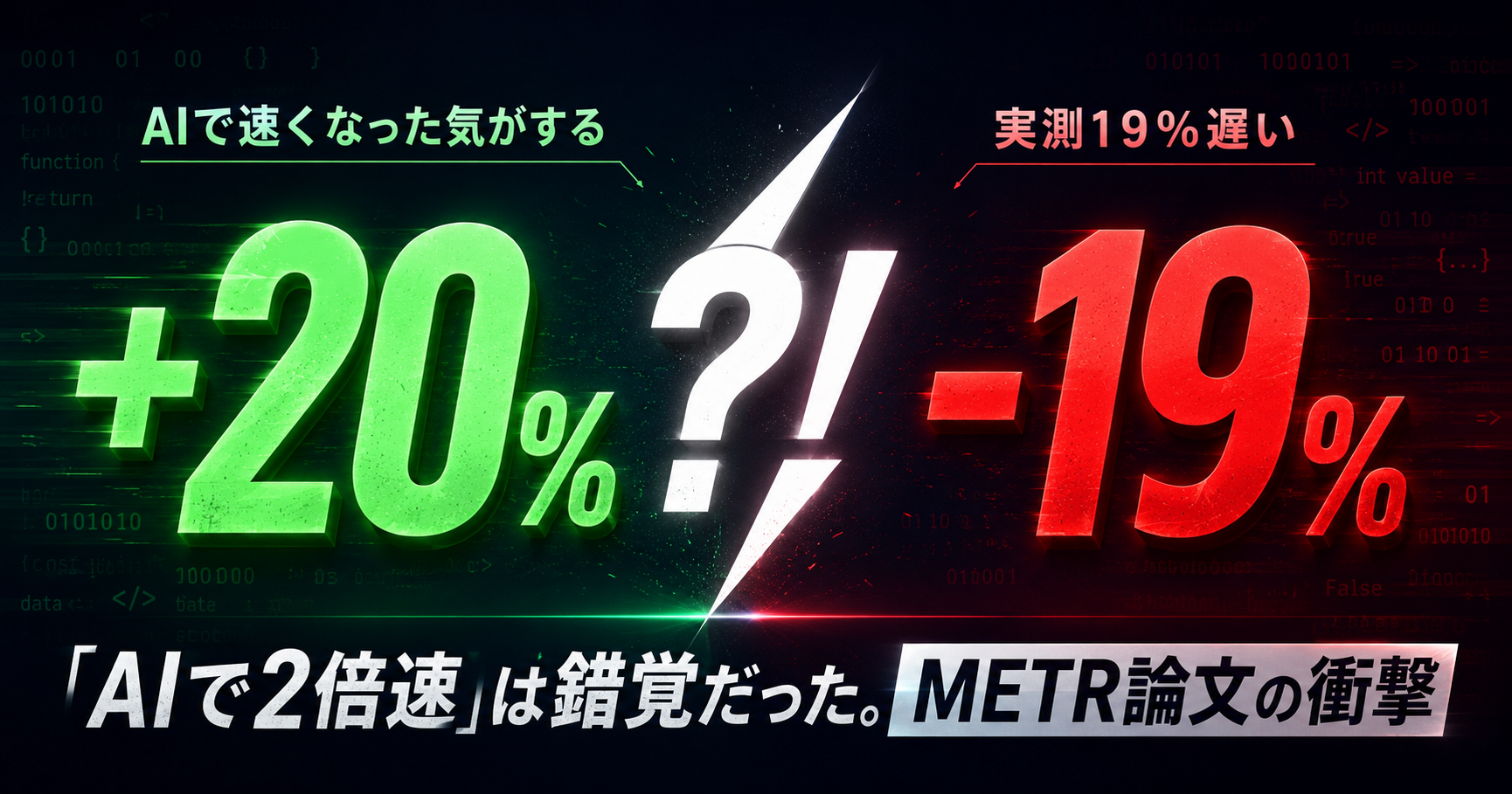

コーディング領域ではClaudeが頭一つ抜けている。 特にClaude Codeに代表されるエージェント型コーディングでは、プロジェクト全体の文脈を理解した上でコードを生成する能力が高い。

GPT-5もCodex後継の強力なコード生成能力を持つが、大規模なコードベースの文脈理解ではClaudeに及ばない場面がある。 Gemini 2.5はGoogle Colabとの連携が強みで、データ分析やML系のコーディングでは力を発揮する。

文章作成・編集

日本語の文章作成では、三者の差が縮まっている。 GPT-5は創造的な文章やマーケティングコピーに強い。 Claudeはファクトに忠実な論理的な文章が得意だ。 Geminiは要約や翻訳で安定した品質を出す。

データ分析

大量のデータを扱う分析タスクではGeminiが有利だ。 1Mトークンのコンテキスト長を活かして、数百ページの資料を一度に読み込める。 BigQueryやGoogle Sheetsとのネイティブ連携も強力だ。

Claudeは200Kトークンで十分な場面が多く、分析の正確性では高い評価を得ている。 GPT-5はCode Interpreterによるインタラクティブな分析が特徴だ。

安全性と倫理的配慮

Anthropicのアプローチ

Claudeは「Constitutional AI」と呼ばれる手法で訓練されており、有害な出力を抑制する仕組みが組み込まれている。 ビジネス用途では、機密情報の取り扱いに対する慎重さが評価されている。 一方で「過度に慎重すぎる」という指摘もある。

OpenAIのアプローチ

GPT-5は柔軟性を重視しつつ、段階的な安全策を講じている。 カスタムGPTsによる用途制限や、企業向けのコンプライアンス機能が充実している。 ただし、過去にはジェイルブレイクの脆弱性が指摘されたこともある。

Googleのアプローチ

Geminiは検索エンジンとの連携を前提に、情報の正確性を重視している。 Ground Truth機能により、回答の根拠をGoogle検索結果で裏付けることができる。 ハルシネーションの低減という点では最も進んでいると言える。

どれを選ぶべきか——用途別ガイド

| 用途 | 推奨モデル | 理由 |

|---|---|---|

| ソフトウェア開発 | Claude 4.5 | コード品質と文脈理解が最高水準 |

| コンテンツ制作 | GPT-5 | 創造性と表現の多様性 |

| 大量文書の要約・分析 | Gemini 2.5 | 1Mトークンの圧倒的コンテキスト長 |

| カスタマーサポート | Claude 4.5 | 安全性と丁寧な応対 |

| リサーチ・調査 | Gemini 2.5 | Google検索との連携でファクトチェック |

三大LLMの競争は、ユーザーにとって歓迎すべき状況だ。 価格は下がり、性能は上がり、選択肢は広がっている。 「一つのモデルに全てを任せる」時代は終わり、用途に応じて使い分ける時代が来ている。 あなたのワークフローに最適なモデルは、あなたの仕事内容が決める。

企業導入の実態——現場の声

スタートアップの選択

スタートアップでは「まず試して、合わなければ乗り換える」アプローチが主流だ。 APIの切り替えコストが比較的低いため、プロジェクトごとにモデルを変える企業も多い。 チャットボットにはClaude、コンテンツ生成にはGPT-5、データ分析にはGeminiと使い分けるケースが報告されている。

大企業の選択

大企業では、セキュリティとコンプライアンスが最優先事項だ。 データの保存場所、学習への利用有無、SOC 2やISO 27001の認証。 これらの要件を満たせるかが、モデル選定の第一のフィルターになる。

その結果、大企業ではAzure OpenAI Service(GPT-5)やGoogle CloudのVertex AI(Gemini)が選ばれるケースが多い。 既存のクラウドインフラとの統合が容易で、エンタープライズ向けのセキュリティ機能が充実しているためだ。 Anthropicも企業向けの提供を強化しているが、AWSのBedrock経由での利用が主流だ。

API料金の詳細比較

| モデル | 入力(100万トークン) | 出力(100万トークン) | 備考 |

|---|---|---|---|

| Claude 4.5 Sonnet | $3 | $15 | 最もバランスの良い価格帯 |

| Claude 4.5 Opus | $15 | $75 | 最高品質、コスト高め |

| GPT-5 | $10 | $30 | 標準的な価格帯 |

| GPT-5 Mini | $1 | $3 | 軽量タスク向け |

| Gemini 2.5 Pro | $1.25 | $5 | 長文処理のコスパ最強 |

| Gemini 2.5 Flash | $0.15 | $0.60 | 大量処理に最適 |

料金面では Gemini のコストパフォーマンスが際立つ。 特に大量のドキュメントを処理するバッチ処理では、Gemini 2.5 Flash の低コストが大きな魅力だ。 一方、品質が最優先の用途(法務文書の分析、コードレビューなど)では、多少コストが高くても Claude Opus や GPT-5 を選ぶ価値がある。

マルチモデル戦略のすすめ

2026年のベストプラクティスは「一つのモデルに依存しない」ことだ。 単一モデルへの依存は、価格変更や障害時のリスクを高める。 LiteLLMやPortkeyのようなLLMゲートウェイを使えば、バックエンドのモデルを簡単に切り替えられる。

重要なのは、各モデルの特性を理解した上で、タスクに応じて最適なモデルを自動的にルーティングする仕組みだ。 簡単な質問にはFlashモデル、複雑な推論にはOpusモデル。 このインテリジェントなルーティングが、コストと品質の最適なバランスを実現する。 LLMの競争が激化する今、一つに賭けるより、柔軟に使い分ける戦略が賢明だ。

オープンソースLLMという第四の選択肢

三大LLMの比較に加えて、オープンソースLLMの存在も忘れてはならない。 Meta のLlama 3、MistralのMixtral、Googleが公開したGemmaなど、商用利用可能なオープンモデルが急速に進化している。

オープンソースLLMの最大の利点は、自社サーバーで完全にオンプレミス運用できること。 データがクラウドに送信されないため、機密性の高い業務にも安心して使える。 カスタムファインチューニングも自由に行える。

ただし、GPUインフラの運用コストと推論品質のトレードオフがある。 最先端の性能を求めるならクローズドモデル、データ主権とカスタマイズ性を重視するならオープンモデルという棲み分けが現実的だ。 いずれにせよ、選択肢が増えていること自体がユーザーにとっての福音だ。